生成AIのセキュリティリスクとは?企業が安全に利用するための対策方法と併せて解説

2026年02月19日

生成AIは、文章作成や画像生成、データ分析など、業務効率や創造性を劇的に向上させるツールですが、その利用には情報漏洩や著作権侵害、ハルシネーションによる誤情報の拡散などのセキュリティリスクが潜んでいます。

こうしたリスクを正しく理解しないまま利用してしまうと、企業においては機密情報の流出や法令違反、信頼失墜といった深刻な事態を招きかねません。

本記事では、生成AIを活用する際に直面しやすいリスクと、それらを回避するための具体的な対策を分かりやすく解説します。安全性を確保しながら生成AIの価値を最大限に引き出すために、これからのセキュリティ対策の指針としてぜひ役立ててください。

【無料DL】AI時代に求められる企業のセキュリティ対策を公開中

生成AIはとても便利ですが、リスクを十分に管理しないまま利用を続けると情報漏洩や著作権侵害といった深刻なトラブルを招く可能性があります。

パーソルグループでは、生成AIに潜むセキュリティリスクや取り組むべきセキュリティ対策とポイントについてまとめた資料を無料で公開しています。

日々の業務で生成AIを活用している方は、ぜひ一度ご覧ください。

目次

生成AIとは

生成AIとは、膨大な学習データをもとに、テキストや画像、動画、音声などさまざまなコンテンツを新たに生み出す人工知能のことです。従来のAIが画像認識や売上予測といった識別作業を得意とする「認識系AI」であったのに対し、生成AIは、その名の通り「新しいコンテンツを生成する」ことを得意としています。

近年は、ChatGPTやGeminiなどをはじめとした生成AIが急速に普及しており、ビジネスだけでなく個人利用の場面でも触れる機会が大幅に増えました。対話形式での情報検索のほか、文章作成・画像生成・コード補完・データ整理など活用シーンは多岐にわたり、日常的な調べものから専門業務の効率化まで幅広く活用されています。

【関連記事】生成AIとは?従来のAIとの違いや企業での活用事例、注意点を解説

生成AIのセキュリティ対策に取り組む重要性

生成AIは便利なツールである一方、入力した情報の扱いが不透明になりやすく、誤情報の出力やバイアスの混入、悪意あるユーザーによる攻撃など、従来のITツールとは異なる種類のリスクを抱えています。そのため、生成AIの普及に伴い、企業・個人を問わず「安全に生成AIを使いこなす」ための対策を講じることが求められているのです。

もし適切な対策を講じないまま生成AIを利用すると、企業であれば機密情報の漏洩や法令違反、ブランド価値の毀損など、深刻な影響につながりかねません。生成AIを安心して継続的に活用するには、技術的な制御だけでなく、利用ルールの整備や倫理的な観点を踏まえたAIガバナンスやルール、運用指針などの確立が欠かせません。

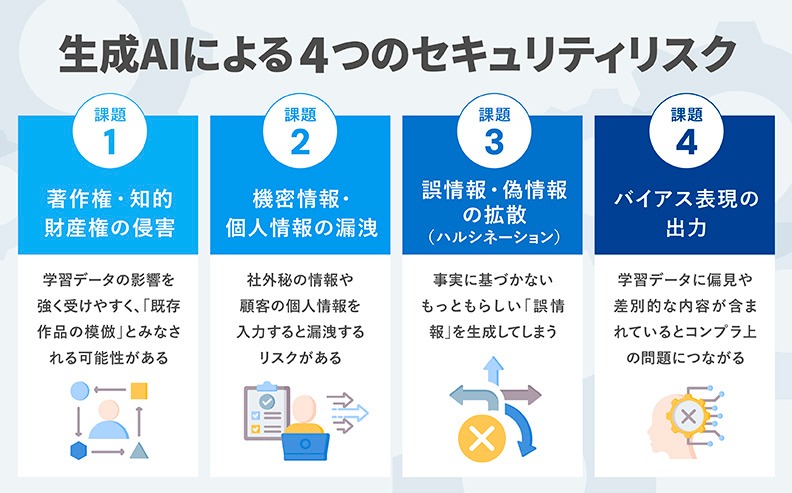

生成AIによるセキュリティリスクの種類

生成AIを活用する際には、利便性の裏側に潜むさまざまなリスクを理解し、適切に対策する必要があります。ここでは、利用者が特に注意すべき主なセキュリティリスクを解説します。

著作権・知的財産権の侵害

生成AIは膨大なデータを学習してコンテンツを生成しますが、学習データによっては出力したコンテンツが既存の著作物や知的財産に類似してしまうケースがあります。特に画像や映像の生成では、学習データの影響を強く受けやすく、「既存作品の模倣」と見なされ訴訟リスクに発展する可能性は否定できません。

企業利用においては、著作権の取り扱いルールを明確にし、生成物のチェック体制を設けておくことが重要です。

機密情報・個人情報の漏洩

多くの生成AIでは、ユーザーが入力したプロンプトがサービス改善のための学習データとして利用される場合があります。そのため、社外秘の情報や顧客の個人情報を入力すると、それらが学習データとして取り込まれ、結果的に第三者に漏洩するリスクが生じます。

最悪の場合は重大な情報事故に発展する可能性があるため、生成AIにデータを学習させる際には、第三者が閲覧しても問題ないかを必ず確認しましょう。

誤情報・偽情報の拡散(ハルシネーション)

ハルシネーションとは、AIが事実に基づかないもっともらしい「誤情報」を生成してしまう現象です。出力された情報をそのまま信じてしまうと、企業においては外部への誤情報の提供や誤った意思決定につながりかねません。

生成AIはあくまで業務上の「補助ツール」として認識し、情報の正確性を人間が最終確認するフローを整備することが必要です。

【関連記事】生成AIのハルシネーションとは?原因と防止するための対策を解説

バイアス表現の出力

生成AIの学習データに偏見や差別的な内容が含まれている場合、AIはそれを反映した不適切な表現を出力することがあります。

これらの出力データをそのまま活用すると、無意識のうちに差別的な発言を拡散してしまったり、企業が不適切な内容を公開してコンプライアンス上の問題につながったりするリスクがあります。バイアス表現を含んだ生成物が外部に公開されないようにするためにも、社内チェックプロセスの構築や、AIが学習したデータの偏りを理解することが重要です。

生成AIのサイバー犯罪への悪用例

生成AIは業務効率化や創造性の向上に大きく寄与する一方、悪意ある攻撃者によってサイバー犯罪の道具として利用される危険性も指摘されています。攻撃の高度化や自動化が進むことで、企業だけでなく個人ユーザーも被害に遭うリスクが高まっています。

ここでは、生成AIがサイバー犯罪へ悪用される代表的な事例を紹介します。

フィッシング攻撃

生成AIは、大量の文章を短時間で自然な文体に整えることが可能です。この性能を悪用すると、攻撃者は精巧なフィッシングメールを量産できるようになるため、メール受信者をだまして偽サイトへ誘導する行為を効率化しています。

また、ターゲットごとに内容を最適化した「パーソナライズド攻撃」も容易となり、従来以上に見抜きにくい攻撃を受ける恐れがあります。こうした攻撃は人の目による検出が難しいため、生成AIによってフィッシング被害がさらに拡大しやすい状況が生まれていると言えるでしょう。

マルウェア等の開発

生成AIは、プログラムコードの生成にも対応しており、特定の目的に合わせたスクリプトやプログラムを素早く生成できます。本来は開発効率化のための機能ですが、攻撃者が悪用すると、悪性スクリプトの作成支援や既存マルウェアの改変による検知回避など、サイバー攻撃の開発工程を効率化する要因になり得ます。

生成AIは攻撃者の技術力に依存していた領域を補えるため、高度な技術を持たない攻撃者でも複雑なサイバー攻撃を容易に実行できるようになる危険性が指摘されているのです。

フェイク・コンテンツを悪用した詐欺と世論操作

生成AIは、人物の声や映像、テキストを本物らしく作り替えることができ、短時間で高精度の偽コンテンツを生み出すことが可能です。これらを悪用することで、なりすましによる個人を狙った詐欺や、意図的に誤情報を拡散して世論を誘導する行為が容易になり、被害者は真偽を判別しづらくなります。

フェイク・コンテンツの生成は、詐欺の巧妙化だけでなく社会的混乱のリスクにもつながり、より強固な真偽判定プロセスの必要性が増しています。

企業における生成AIのセキュリティ対策

企業が生成AIを安全に活用するには、運用方針の策定・技術対策・従業員への教育をバランスよく整え、組織としてのAIガバナンスを継続的に強化していくことが求められます。ここでは、生成AIのセキュリティ対策として企業が押さえるべき基本的なポイントを解説します。

ガイドラインの策定

まずは、経営層や現場の従業員など全社で共通して従うべき生成AIのルールを定め、組織としての判断基準を明確にします。特に、機密情報や個人情報など入力が禁止されるデータの範囲や、生成された文章やコードを使用する前のファクトチェック手順、外部ツールを利用する際の承認プロセスなどは、実務レベルで詳細に定めることが欠かせません。

生成AIのガイドラインは単なる禁止事項の列挙ではなく、業務でどう安全に活用するかを示す運用指針として設計することが重要です。

企業が押さえるべきリスクとガイドライン策定のポイント

生成AIを利用禁止にするだけでは「シャドーAI(会社が把握していないAI利用)」を招き、一方でルールが曖昧なままでは情報漏洩やコンプライアンスリスクが高まります。本資料では、生成AIガイドラインが必要な理由から、リスク整理、策定の考え方、盛り込むべき項目例までをわかりやすく解説しています。

ベンダーの選定

生成AIツールを導入する際は、提供元(ベンダー)や生成AI自体に十分なセキュリティ対策が施されているかを確認し、自社のリスク基準を満たしているかを判断します。例えば、入力データが学習に利用されるかどうか、暗号化やアクセス制御の水準、プロンプト漏洩防止の仕組みといった技術仕様は必ずチェックポイントに含めるべき項目です。

また、サプライチェーン全体がセキュアに保たれているかも重要で、ベンダーの委託先や外部システムとの連携部分で脆弱性が生じないよう、包括的な評価を行う必要があります。

従業員へのAIリテラシー教育

生成AIのガイドラインが存在するだけでは安全な運用は成立しません。利用者がその意図を理解し、実際の業務で正しく判断できるよう、継続的な教育プログラムを整備しましょう。

具体的には、生成AIの仕組みやセキュリティリスクを学ぶ研修、ケーススタディ形式の演習、理解度を可視化するテストの実施などが効果的です。現場の担当者が「どこまで学習させてよいか」「どのように検証すべきか」を判断できる状態をつくることで、組織全体のAIリテラシーが底上げされます。

【関連記事】ITリテラシーとは?低い場合の問題点・高める方法・メリットを解説

技術的なセキュリティ対策の実施

運用ルールと同時に、社内の技術的なセキュリティ対策も不可欠です。機密情報が意図せず生成AIに入力されるのを防ぐフィルタリングやDLP(Data Loss Prevention)機能、利用が認められていないAIツールを検出するシャドウAI対策、利用ログの記録・監査など、IT基盤としての安全性を確保する仕組みを整備します。こうした対策により、利用者の判断ミスや意図的なルール逸脱を技術面から補完できます。

定期的なリスクアセスメント

生成AIのセキュリティに関するガイドラインは、作って終わりではなく、運用しながら改善し続けることで初めて機能します。ガイドラインの遵守状況をモニタリングし、問題が生じていないかを定期的に評価するとともに、国内外の法規制、各ベンダーの仕様変更、新たなサイバー攻撃手法などの外部環境に合わせてポリシーを更新しましょう。環境変化に即応できる体制を整えることが、組織としての生成AI活用の継続的な安全性につながります。

生成AIのセキュリティを策定する際には、全社のガバナンスを策定する委員会を設置することも有効です。

AIガバナンスについては、以下記事をご覧ください。

【関連記事】AIガバナンスとは?企業が今取り組むべきリスク管理のポイントを解説

従業員個人における生成AIのセキュリティ対策

前述の通り、企業における対策が不可欠であるのはもちろん、従業員個人においても生成AIの使い方には十分に注意する必要があります。近年では業務上での活用場面も増えているため、基本的なセキュリティ対策の理解が欠かせません。

機密情報や個人情報入力の禁止

生成AIへ入力した内容は、ツールによっては学習データとして扱われる可能性があります。氏名・住所・連絡先などの個人情報はもちろん、SNSのログイン情報、家族構成、仕事に関する内部情報など、プライバシーや身元特定につながる内容の入力は避けましょう。

「便利だから」と学習させてしまうのではなく、入力した情報が意図せず生成AIの学習データとして利用されるリスクを常に意識することが大切です。

生成情報の確認

生成AIが出力する情報は、必ずしも正確ではなく、事実と異なる内容(ハルシネーション)が紛れ込むことがあります。判断を誤ると業務に大きな支障が出るテーマについては、必ず複数の情報源を確認するようにしましょう。

また、画像や動画などの生成物についても、ほかの著作物に酷似していないか、偏見を助長する表現が含まれていないかといった観点で確認することが肝心です。

提供元の確認

セキュリティ対策が施されていない生成AIや、怪しい提供元のツールには、データの抜き取りやマルウェア感染などのリスクが潜んでいる可能性があります。利用する際は、運営企業の信頼性や、プライバシーポリシー、データの扱い方針を必ず確認しましょう。

【無料DL】AI時代に求められる企業のセキュリティ対策を公開中

生成AIはとても便利ですが、リスクを十分に管理しないまま利用を続けると情報漏洩や著作権侵害といった深刻なトラブルを招く可能性があります。

パーソルグループでは、生成AIに潜むセキュリティリスクや取り組むべきセキュリティ対策とポイントについてまとめた資料を無料で公開しています。

日々の業務で生成AIを活用している方は、ぜひ一度ご覧ください。

まとめ

生成AIは、創造性や効率性を向上させる強力なテクノロジーですが、その裏には情報漏洩や、ハルシネーション、著作権の侵害など、看過できないセキュリティリスクが存在します。

企業においては、ガイドライン策定・教育・技術的対策といった多層的なAIガバナンスを構築することが欠かせません。個人ユーザーもまた、入力情報の管理や生成内容のチェック、信頼できるサービスの選択など、日々の利用に直結する基本的なセキュリティ対策を徹底する必要があります。

生成AIに潜むセキュリティリスクを正しく理解し、状況に応じた防御策を講じることで、生成AIを安全に使えるツールへと変えられます。適切な使い方を身につけ、安全性と利便性を両立させながら、生成AIの可能性を最大限に活かしていきましょう。

監修・インタビュー

パーソルクロステクノロジー株式会社

IT事業 DX統括本部 DXソリューション本部 DX営業部

部長

神田 淳

2010年の入社以来、IT領域で数多くのプロジェクトを牽引。ローコード開発やAI活用による業務改善、PMO支援、システム開発から業務設計まで幅広い経験を積み、顧客の企画段階から新サービス創出なども支援。

業務部門、開発、情報システム部門、コンサルタント、ミドルバックなど、企業に必要な機能を横断的に経験し、戦略から実行まで一貫したサポートを提供。サービス開発や業務設計、サポート窓口設計なども担当し、現場と経営をつなぐ役割に従事。

現在は、Microsoft事業を中心に営業戦略、ソリューション開発、マーケティング企画などを統括。