AIガバナンスとは?企業が今取り組むべきリスク管理のポイントを解説

2026年02月24日

デジタルトランスフォーメーション(DX)の波が押し寄せる中、AI(人工知能)は企業の競争力を左右する重要な要素となっています。特に近年は高性能な生成AIが急速に普及したことで、ビジネスシーンにおける活用範囲は劇的に拡大しました。

しかし、AIの利用が拡大すればするほど、それに伴うリスクも増大します。企業がAIを安全かつ倫理的に利用し、その恩恵を最大限に享受するために不可欠なのが「AIガバナンス」です。

本記事では、AIガバナンスの基本から、策定の具体的なステップ、そして成功のためのポイントまでを詳しく解説します。

「御社のAIガバナンス整っていますか?」

【無料DL】AIガバナンス策定ノウハウBOOKを公開中

「社内のAI活用に関するルールが整備されておらずリスクを抱えた状態である」そんな企業に向け、

パーソルグループでは、社内のAI活用ルールを整備するためのAIガバナンスの必要性や策定までの流れ、策定時に押さえておくべきポイントを分かりやすく整理した資料を無料で公開しています。

AIガバナンス策定の際やリスクの洗い出しなどに、ぜひお役立てください。

AIガバナンスとは

AIガバナンスとは、企業がAIシステムを設計・開発・運用・廃棄する一連のプロセスにおいて、倫理的・法的・社会的な責任を果たしつつ、リスクを管理し、ビジネス価値を最大化するために確立する体制やルールの総称です。

生成AIの導入が急速に進む現在、企業は情報漏洩や著作権侵害といった具体的なリスクに直面しています。AIガバナンスは、これらのリスクを未然に防ぎ、AIを安全かつ持続的に活用するための組織的な枠組みとして機能します。

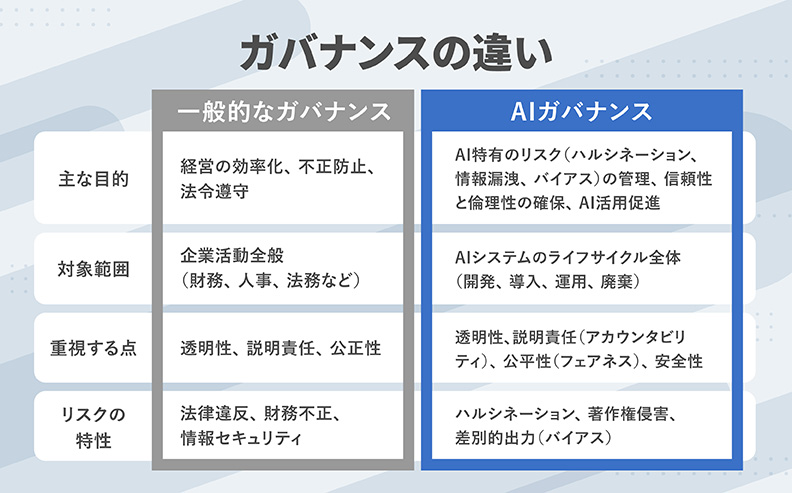

一般的なガバナンスとの違い

従来のコーポレートガバナンス(企業統治)は、主に企業の不正防止、法令遵守(コンプライアンス)、経営の透明性向上を目的としています。一方のAIガバナンスは、これら一般的な統治の概念に加え、AI特有の技術的・倫理的なリスクに焦点を当てています。

| 一般的なガバナンス | AIガバナンス | |

|---|---|---|

| 主な目的 | 経営の効率化、不正防止、法令遵守 | AI特有のリスク(ハルシネーション、情報漏洩、バイアス)の管理、信頼性と倫理性の確保、AI活用促進 |

| 対象範囲 | 企業活動全般(財務、人事、法務など) | AIシステムのライフサイクル全体(開発、導入、運用、廃棄) |

| 重視する点 | 透明性、説明責任、公正性 | 透明性、説明責任(アカウンタビリティ)、公平性(フェアネス)、安全性 |

| リスクの特性 | 法律違反、財務不正、情報セキュリティ | ハルシネーション、著作権侵害、差別的出力(バイアス) |

AIガバナンスはAI活用の「ブラックボックス化」を防ぎ、その判断過程や結果に対して責任を持つことを可能にする、現代の経営に欠かせない仕組みと言えるでしょう。

【関連記事】ガバナンスとは?必要な背景やコンプライアンスとの違い・強化施策を解説

なぜAIガバナンスが必要なのか

生成AIは、文章作成やコード生成、画像生成など、これまで人間しかできなかった「創造的な業務」に活用され、業務効率を飛躍的に向上させる可能性を秘めています。

しかし、生成AIが業務に深く浸透するほど、AIが生み出すアウトプットの品質管理の難しさや、情報の取り扱いに関するリスクが直接的に企業経営に影響を及ぼす可能性が高まるのも事実です。

企業の信頼性向上

AIガバナンスは、企業が直面する具体的なリスクを回避し、企業の社会的信頼(トラスト)を維持・向上させるために欠かせません。代表的なリスクと対策として、以下のようなものが挙げられます。

情報漏洩リスク

多くの生成AIサービスは、ユーザーの入力データを学習に利用します。AIガバナンスによって、入力禁止情報(機密情報や個人情報など)を明確に定義し、技術的な対策(API連携の活用など)を講じることで、意図しない情報漏洩を防ぎます。

著作権・商標権侵害リスク

AIが生成したコンテンツが既存の著作物と酷似した場合、企業が訴訟リスクを負う可能性があります。ガバナンス体制の下で、最終成果物の人によるチェック体制や、著作権を侵害していないかのチェックプロセスを設けることで、法的なリスクを低減します。

ハルシネーション(誤情報生成)

AIが事実に基づかない情報を生成する現象は、誤った意思決定や顧客への誤情報提供につながり、企業の信頼を根底から揺るがします。ガバナンスによりファクトチェックの義務化を徹底することで、情報の正確性を担保します。

【関連記事】生成AIのハルシネーションとは?原因と防止するための対策を解説

サービス品質の低下

AIを導入したことによって、サービスの品質が低下して顧客からの信頼低下につながる可能性もあります。例えば、カスタマーサポートにAIを導入した場合において、AIが適切な情報を参照せずに顧客へ的外れなサポートを繰り返す場合、品質低下と捉えられて不信感へとつながります。

AIを導入するだけでなく、顧客がどのように使用してどのようなベネフィットを得るのかまで設計してから活用することで、信頼感の醸成へとつながります。

AIガバナンスに関する法規制

現在、各国・地域でAIの利用に関する法規制やガイドラインの策定が急速に進んでいます。

特に欧州連合(EU)のAI Actは、AIをリスクレベルに応じて分類し、高リスクAIに厳格な規制を課すものであり、国境を越えて事業を行う日本企業にも大きな影響を与えています。また、日本国内でも、経済産業省や総務省などがAIに関するガイドラインを発表しており、企業にはこれらの動向を継続的に把握し、社内ルールを適応させることが求められます。

AIガバナンスは単なるリスク管理にとどまらず、法規制への適合(リーガル・コンプライアンス)を果たすための生命線となっているのです。

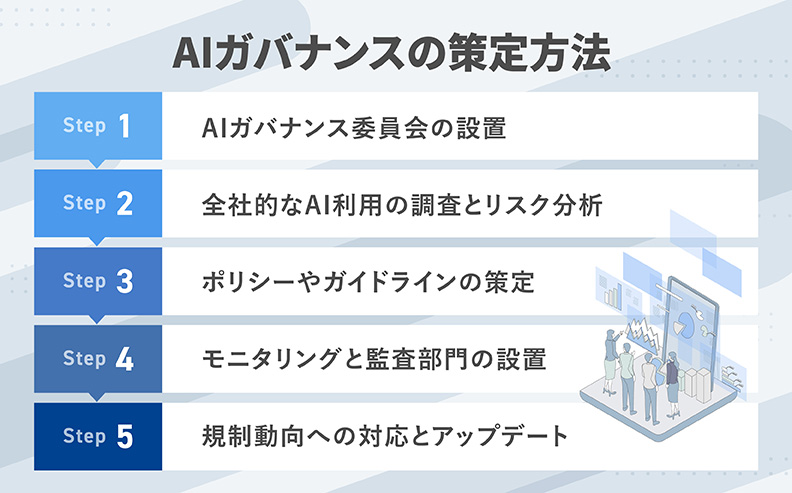

AIガバナンスの策定方法

AIガバナンスを効果的に策定し運用するためには、以下の5つのステップでPDCAサイクルを回すことが推奨されます。

ステップ1.AIガバナンス委員会の設置

まず、AIガバナンスを推進・監督する横断的な組織体制を確立する必要があります。AIガバナンス委員会は、AI利用に関する全社的な基本方針の策定をはじめ、リスク分析の実施、ガイドラインの承認、問題発生時の対応責任の明確化などを主導します。

委員会の構成としては、意思決定者としての経営層、企業のコンプライアンス遵守を担う法務部門、セキュリティを管理する情報システム部門に加え、実際にAIを活用する事業部門なども巻き込んだ、横断的な体制が望ましいと言えます。経営層の強いコミットメントを得て、各部門の専門知識を結集した委員会を設置することが、ガバナンスを形骸化させないための第一歩です。

併せて、AIを活用する従業員のAIリテラシー教育計画の策定も必要です。ただAIを導入しても、使用者のAIリテラシーが低い場合にはガバナンス違反を引き起こす可能性があります。現場での定着・活用を目指すためには、最もAIを理解しているガバナンスチームが計画を策定し、リテラシー醸成に努めることが望ましいでしょう。

ステップ2.全社的なAI利用の調査とリスク分析

委員会設置後は、全社でAIがどのように使われているかの現状を正確に把握しなければなりません。

まず実態調査として、従業員が業務で利用しているAIツール(正式導入ツールおよび申告していない個人利用)の種類、利用頻度、利用業務について調査します。特に申告のないAI利用については、インシデント発生時の管理責任などが曖昧となりガバナンス遵守の妨げとなる可能性があるため、必ず最初に入念な実態調査を実施しましょう。

さらに調査結果に基づき、各業務でのAI利用がもたらすリスク(機密情報入力やハルシネーションによる損害など)を特定し、その深刻度と発生可能性を評価します。

これらの分析により、特に優先度の高い対策を講じるべきリスクの特定が可能になります。

ステップ3.ポリシーやガイドラインの策定

リスク分析の結果に基づき、全従業員が遵守すべき具体的なルールをポリシー(方針)やガイドライン(実務ルール)として文書化します。

ポリシーにはAI利用の基本理念、倫理原則、最終責任の所在(人間にあること)などを明記します。ガイドラインには、例えば以下のような内容を組み込むとよいでしょう。

著作権・商標権のリスクへの具体的対策

AIが生成したコンテンツ(テキスト、画像、コード)を商用利用する際の具体的な対策を定めます。

| 著作権・商標権侵害のリスクへの対策例 |

|---|

|

ハルシネーション対策

AIが誤情報を生成するリスクに対応するための措置を定めます。

| ハルシネーション対策例 |

|---|

|

ステップ4.モニタリングと監査部門の設置

策定したルールが組織全体で遵守され、AI利用が意図した効果を生んでいるかを継続的に検証する体制を構築することも重要です。

具体的には、AI利用ログの監視(禁止情報入力の有無、利用頻度など)を行ったり、インシデント(問題発生)報告体制を整備したりする必要があります。また、定期的に社内ルールが適切に運用されているかを監査部門が独立してチェックしましょう。これにより、ルールの形骸化を防ぎ、ルールの実効性を維持します。

ステップ5.規制動向への対応とアップデート

AI技術は日進月歩で進化し、それに伴い法規制や倫理観も変化します。そのため、国内外の法規制や、各省庁から発表されるガイドラインの最新情報を継続的に収集・分析する必要があります。

収集した情報を踏まえて、モニタリングで得られた社内の運用実績に基づき、ポリシーやガイドラインを柔軟かつ迅速に改定し、PDCAサイクルを回し続けることが重要です。

AIガバナンスを策定する際のポイント

AIガバナンスを単なるお題目で終わらせず、企業価値向上につなげるための重要なポイントを解説します。

部門横断型のリスク管理体制を構築する

AIガバナンスは、特定の部門だけで完結するものではありません。最終的な意思決定を行う経営層はもちろん、法務部門は法的・倫理的なリスクを分析し、ルールを策定する必要があります。またAIを活用する事業部門には、現場の課題や非効率な利用実態を正確に伝え、実効性のあるルール作りに貢献することが求められます。

ガバナンスを浸透させたい場合には、ガバナンスの策定段階からIT部門に限らずに法務や事業部門を巻き込みましょう。一方的に策定するのではなく、事業部門からの意見や法務観点でのコンプライアンスリスクを洗い出すことで、AIガバナンスを遵守する立場であることを意識づけることができます。

これらが一体となったクロスファンクショナルな推進体制を構築することで、ルールと現場の実態との乖離を防ぎましょう。

技術面と運用面の両軸での対策を講じる

AIガバナンスは、技術的な制限だけでなく、人による運用ルールも組み合わせることで効果を発揮します。

技術面の対策としては、入力情報のフィルタリング機能の導入、情報漏洩を防ぐセキュアなAI環境(プライベートLLMなど)の構築、既存システムとの安全な連携などがあります。一方、運用面では利用ガイドラインの策定、全従業員への研修、インシデント報告フローの明確化、生成物の最終チェック体制などが挙げられるでしょう。

これらの両輪を回すことで、リスクを最小限に抑えつつ、最大限にAIの利便性を享受することにつながります。

【関連記事】生成AIのセキュリティリスクとは?企業が安全に利用するための対策方法と併せて解説

AIガバナンスの重要性を周知する

ルールを策定しても、従業員に浸透しなければ意味がありません。策定したガイドラインの内容を、単なるAIガバナンスの共有で終わらせず、eラーニングやワークショップなどを通じて、なぜそのルールが必要なのか(リスクの重大性)と具体的な利用方法を徹底的に周知しましょう。

また、AI導入の最大の課題の一つである「そもそもなぜAIを導入するのか」という目的を全社で共有し、ガバナンスがその目的達成を支援するためのものであることを理解させることも非常に重要です。

AI人材の育成に継続的に取り組む

AIを使いこなせるリテラシーを持った人材の育成は、ガバナンスの実効性を高める基盤となります。従業員間におけるスキル格差を是正するため、例えばプロンプトの書き方やAIの特性を理解した利用方法を教える研修(プロンプトエンジニアリングを含む)を実施するなどの取り組みを行うとよいでしょう。

また、AIリテラシーを身に付けた人材が、知識を発揮できる環境づくりについても重要です。習得したスキルが無駄にならないよう、活用のために環境を整備しましょう。

AIの運用・保守、既存システムとの連携、ガバナンス体制の維持を担う専門人材を社内で育成する、または外部から採用することも必要です。

【関連記事】AI人材とは?職種や必要なスキル、育成のポイント・注意点を解説

AIガバナンスに関する事例

パーソルグループでは、社員専用の対話型生成AI「PERSOL Chat Assistant(CHASSU)」を導入し、社員一人ひとりが目的に合わせてAIを活用できるセキュアな環境を整備しています。国内グループ全社の社員約19,000人を対象に展開し、2024年9月時点での利用率は92.3%に上っています。

生成AIの業務利活用を推進するにあたって、まず取り組まれたのがガバナンスの整備です。パーソルグループでは推進チームにガバナンス担当者を加え、アジャイル・ガバナンスで進めました。

AI特有のレビューのポイント、審議者を加えた審議プロセスを構築することも意識。レビューには法務や情報セキュリティ担当者に加え、データやAI技術を理解しているメンバーも含め、協働しながらルールを作っていきました。

一般社員が参照するAIサービス利用における汎用的なセキュリティガイドラインを公開し、以降は必要に応じて、ガイドラインをブラッシュアップしながらアップデート版も公開しています。また、企画者・審議者向けのガイドラインやチェックリスト形式のリスクアセスメントツールも作成しました。これにより、生成AIの利活用における情報漏洩などのリスクを抑えつつ、社員が業務にAIを組み込める土台が作られています。

【無料DL】AIガバナンスを策定するためのノウハウBOOKを公開中

「生成AIの活用が進んできているが、社内のAI活用に関するルールが整備されておらず危険な状態である」といったお悩みを抱えていませんか?

パーソルグループでは、社内のAI活用ルールを整備するためのAIガバナンスの必要性や策定までの流れ、策定時に押さえておくべきポイントを分かりやすく整理した資料を無料で公開しています。

生成AI活用を推進する方でなく、業務に生成AIを活用している方はぜひご覧ください。

まとめ

生成AIは、定型業務の効率化や優れたアイデア創出、顧客満足度の向上など、企業に計り知れないメリットをもたらす一方で、情報漏洩や著作権侵害、ハルシネーションといった課題とリスクがあるのも事実です。企業がAIの恩恵を安全かつ持続的に享受し、競争力を高めるためには、これらのリスクを正しく理解し、自社に合ったAIガバナンスを構築・運用していくことが重要です。

監修・インタビュー

パーソルクロステクノロジー株式会社

IT事業 DX統括本部 DXソリューション本部 DX営業部

部長

神田 淳

2010年の入社以来、IT領域で数多くのプロジェクトを牽引。ローコード開発やAI活用による業務改善、PMO支援、システム開発から業務設計まで幅広い経験を積み、顧客の企画段階から新サービス創出なども支援。

業務部門、開発、情報システム部門、コンサルタント、ミドルバックなど、企業に必要な機能を横断的に経験し、戦略から実行まで一貫したサポートを提供。サービス開発や業務設計、サポート窓口設計なども担当し、現場と経営をつなぐ役割に従事。

現在は、Microsoft事業を中心に営業戦略、ソリューション開発、マーケティング企画などを統括。