生成AIガイドラインとは? 策定する目的と重要性を解説

2026年04月06日

生成AIガイドラインは、企業が生成型AIを安全かつ効果的に導入・運用するためのルールと指針です。

本記事では、生成AIガイドラインを策定する目的(リスク管理、法令遵守、品質担保)と企業にとっての重要性(信頼性維持、ブランド保護、業務効率化)をビジネス視点で整理し、ガバナンス体制や従業員教育、導入手順・チェックリストのポイントまで分かりやすくご紹介します。

プロンプト活用を“業務で安全に”進めるための

生成AIガイドライン策定のポイント

プロンプトを工夫すれば生成AIの出力品質は高まりますが、使い方次第では情報漏洩やコンプライアンス面のリスクも増えます。業務活用を広げるほど「社内ルール」の整備が欠かせません。

本資料では、生成AIガイドラインが必要な理由から、特有のリスク整理、作り方、盛り込むべき項目例までを解説。生成AIを安心して業務活用するための、ガイドライン策定・見直しの参考としてご活用ください。

目次

生成AIガイドラインの背景と必要性

生成AI技術は、文章生成や画像生成、音声合成など多岐にわたる分野で活用されています。これにより、業務効率化やクリエイティブな活動の支援が可能となり、企業や個人にとって欠かせないツールとなりつつあります。しかし、その一方で、生成AIの利用にはいくつかの課題が存在します。

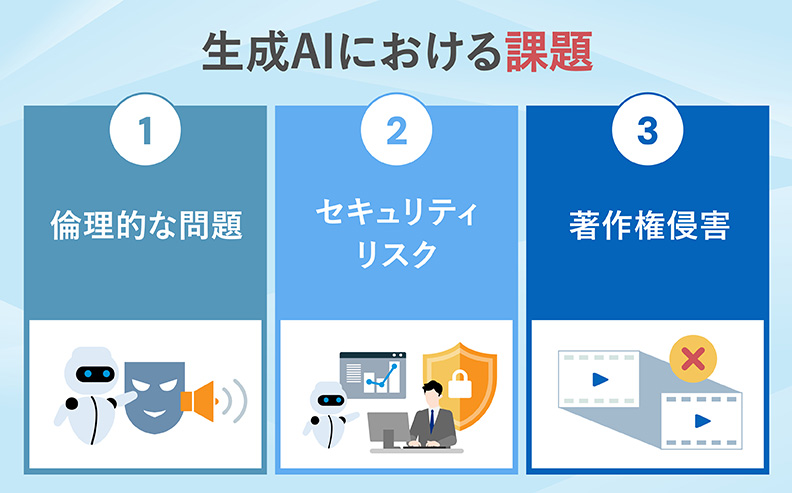

背景にある技術進化と課題

生成AIの進化は目覚ましいものがあります。例えば、自然言語処理技術を活用したチャットボットや、画像生成AIによるデザイン支援などが挙げられます。しかし、この技術進化に伴い、以下のような問題が浮上しています。

-

- 倫理的問題:生成AIが誤情報を生成したり、偏見を助長したりする可能性がある

- セキュリティリスク:機密情報の漏洩や悪意ある利用が懸念される

- 著作権問題:AIが生成したコンテンツの著作権やライセンスに関する議論が必要

これらの課題を解決するためには、明確なルールや指針が不可欠です。そこで登場するのが生成AIガイドラインです。このガイドラインは、技術の利便性を最大化しつつ、リスクを最小化するための枠組みを提供します。

ガイドラインの必要性

生成AIガイドラインが必要とされる理由は、以下の通りです。

-

- 安全な利用の確保:ガイドラインを設けることで、生成AIの利用範囲や禁止事項を明確化し、不適切な利用を防ぐ

- 信頼性の向上:ガイドラインに基づいた運用は、生成AIの信頼性を高め、利用者に安心感を提供する

- 法的リスクの回避:著作権や個人情報保護に関する規定を設けることで、法的トラブルを未然に防ぐ

生成AIガイドラインは、技術の進化とともに生じる課題に対応し、社会全体で生成AIを安全に活用するための基盤となるのです。

【関連記事】生成AIのセキュリティリスクとは?企業が安全に利用するための対策方法と併せて解説

生成AIガイドラインの主な構成

生成AIガイドラインは、具体的な利用方法や禁止事項、データ管理、著作権に関する規定など、多岐にわたる内容を含んでいます。これらの条項は、生成AIを安全かつ効果的に活用するための指針として機能します。

利用範囲・禁止事項の規定

生成AIガイドラインの中核を成すのが、利用範囲と禁止事項に関する規定です。この規定は、生成AIをどのように利用すべきか、またどのような利用が不適切であるかを明確に示しています。

-

- 誤情報の生成:偽のニュースや誤解を招く情報を生成する行為

- 差別的なコンテンツの生成:人種、性別、宗教などに基づく偏見を助長する内容の生成

- 違法行為の助長:詐欺や犯罪行為を支援する目的での利用

これらの禁止事項を明確にすることで、生成AIの利用が社会的に受け入れられるものとなり、技術の信頼性が向上します。

また、利用範囲については、生成AIが適切に活用されるべき分野や目的が定義されています。例えば、教育や医療、ビジネス支援など、社会的に有益な用途が推奨されます。このような規定は、生成AIのポジティブな活用を促進する役割を果たします。

データの安全管理と個人情報保護のポイント

生成AIを利用する際には、データの安全管理と個人情報保護が重要な課題となります。ガイドラインでは、これらのポイントについて具体的な指針が示されています。

まず、データの安全管理に関しては、以下のような対策が求められます。

-

- 暗号化の実施:データの送受信時に暗号化を行い、不正アクセスを防止する

- アクセス制限:データにアクセスできる権限を厳密に管理し、必要最低限の範囲に限定する

- 定期的な監査:データ管理体制を定期的に見直し、セキュリティの向上を図る

次に、個人情報保護については、以下のような規定が設けられています。

-

- 収集目的の明確化:個人情報を収集する際には、その目的を明確にし、利用者に説明する

- 利用範囲の限定:収集した個人情報を、事前に定めた範囲内でのみ利用する

- 削除の権利:利用者が希望する場合には、個人情報を速やかに削除する。

これらの規定は、生成AIの利用者が安心して技術を活用できる環境を整えるために不可欠です。

著作権やライセンスに関する注意点

生成AIが生成するコンテンツに関しては、著作権やライセンスの問題がしばしば議論されます。生成AIガイドラインでは、この点についても明確な指針が示されています。

例えば、以下のような注意点が挙げられます。

-

- 生成コンテンツの著作権:AIが生成したコンテンツの著作権は、利用者に帰属するが、利用するAIツールの規約によって異なることがある

- 第三者の権利侵害の防止:生成AIが既存の著作物を模倣したり、第三者の権利を侵害したりする可能性があるため、生成コンテンツの利用には注意が必要

- ライセンス契約の遵守:AIツールを利用する際には、そのライセンス契約を遵守し、規定された範囲内で利用することが求められる

これらの注意点を守ることで、法的リスクを回避し、生成AIを安心して活用することができます。

実際に発生した生成AIによるセキュリティ事故

生成AIの利用が広がる中で、いくつかのセキュリティ事故が報告されています。これらの事例は、生成AIガイドラインの重要性を再認識させるものです。

機密情報の流出

ある企業では、生成AIを利用して業務効率化を図っていました。しかし、従業員が機密情報をAIツールに入力した結果、その情報が外部に漏洩するという事故が発生しました。この事例では、以下のような問題が浮き彫りになりました。

-

- 入力データの管理不足:機密情報をAIツールに入力する際のルールがあいまいだった

- ツールのセキュリティ対策の不備:利用していたAIツールが十分なセキュリティ対策を講じていなかった

このような事故を防ぐためには、ガイドラインに基づいたデータ管理体制の構築が不可欠です。

ハルシネーション

生成AIが誤った情報を生成する「ハルシネーション」の問題も深刻です。例えば、ある医療機関では、生成AIを利用して患者向けの情報を作成していましたが、AIが誤った医学情報を生成し、それが患者に提供されるという事態が発生しました。

この事例では、以下のような課題が明らかになりました。

-

- 生成内容の検証不足:AIが生成した情報を十分に検証せずに公開してしまった

- AIの限界の理解不足:AIが誤情報を生成する可能性を十分に認識していなかった

このような問題を防ぐためには、生成AIの利用範囲を明確にし、生成内容を慎重に検証するプロセスを導入する必要があります。

生成AIガイドラインは、これらの事例を教訓として、技術の安全な利用を促進するための重要な役割を果たします。生成AIを活用する際には、ガイドラインを遵守し、リスクを最小化することが求められるのです。

【関連記事】生成AIのハルシネーションとは?原因と防止するための対策を解説

各業界・自治体における生成AIガイドライン事例

生成AIの活用が広がる中で、各業界や自治体は独自のガイドラインを策定し、適切な利用を促進しています。ここでは、国や行政機関、企業・法人がどのように生成AIガイドラインを構築しているかを具体的に見ていきます。

国や行政機関のガイドライン事例

国や行政機関は、生成AIの利用に関するガイドラインを策定することで、社会全体の安全性や倫理性を確保しています。例えば、日本政府は「AI原則実践のためのガバナンス・ガイドライン」として、透明性、公平性、プライバシー保護などを重視した指針を発表しています。この指針は、AI技術が社会に与える影響を最小限に抑えつつ、技術革新を促進することを目的としています。

また、欧州連合(EU)は2024年5月、世界初となる人工知能(AI)の開発や運用を包括的に規制する「AI法」を承認、同年8月に発効し、生成AIを含むAI技術のリスクレベルに応じた規制を導入しています。この法案では、高リスクのAIシステムに対して厳格な審査を求める一方で、低リスクの技術には柔軟な対応を取る方針を示しています。これにより、技術革新と社会的責任のバランスを保つことが可能となっています。

さらに、アメリカでは、国立標準技術研究所(NIST)が「AIリスク管理フレームワーク」を公開し、企業や研究機関がAI技術を安全かつ倫理的に利用するための具体的な手法を提供しています。このフレームワークは、リスク評価や透明性の確保、継続的なモニタリングを重視しており、生成AIの利用における信頼性を向上させる役割を果たしています。

これらの事例から分かるように、国や行政機関は生成AIの利用に伴うリスクを管理し、社会全体の利益を最大化するためのガイドラインを策定しています。これらの取り組みは、生成AIが安全かつ効果的に活用されるための基盤を提供していると言えるでしょう。

企業・法人のガイドライン事例

企業や法人もまた、生成AIの活用における倫理的課題や法的リスクに対応するため、独自のガイドラインを策定しています。例えば、Googleは「AIに関する原則」を公開し、生成AIを含むAI技術の開発と利用において、ユーザーの安全、セキュリティ、プライバシー保護を重視する姿勢を示しています。この原則は、技術革新を進める一方で、社会的責任を果たすための具体的な指針を提供しています。

また、Microsoftは「Responsible AI Standard」を導入し、生成AIの利用における倫理的な課題に対応しています。この標準では、AI技術の公平性、信頼性、透明性などの価値を尊重しながらAIシステムを構築するため、具体的な手法が示されており、企業全体での適用が進められています。

さらに、日本国内では、楽天が生成AIを活用したサービスの開発において、独自のガイドラインを策定しています。このガイドラインでは、ユーザーのプライバシー保護やデータの適切な管理を重視しており、生成AIの利用が社会的に受け入れられる形で進められています。

これらの事例から分かるように、企業や法人は生成AIの活用に伴うリスクを管理し、技術革新を促進するためのガイドラインを策定しています。これにより、生成AIが安全かつ効果的に利用される環境が整備されているのです。

生成AIガイドラインの策定方法

生成AIガイドラインを策定することは、技術の安全性や倫理性を確保するために不可欠です。ここでは、具体的な策定方法について解説します。

1.ガイドラインのひな形を作成する

生成AIガイドラインを策定する際の第一歩は、ひな形を作成することです。このひな形は、企業や組織が生成AIを利用する際の基本的なルールや指針を示すものです。

ひな形を作成する際には、既存のガイドラインや業界標準を参考にすることが有効です。例えば、国や行政機関が公開しているAI原則やフレームワークをもとに、自社のニーズに合わせた内容を組み込むことができます。また、専門家や法律の助言を受けることで、より実効性の高いガイドラインを作成することが可能です。

さらに、ひな形を作成する際には、具体的な事例やケーススタディを盛り込むことが重要です。これにより、ガイドラインが抽象的なものではなく、実際の業務に適用可能なものとなります。例えば、生成AIを利用したマーケティング活動におけるデータ管理の方法や、顧客対応における倫理的な課題への対応策などを具体的に示すことが求められます。

2.社内周知を行う

ガイドラインを策定した後は、社内での周知活動を行うことが重要です。ガイドラインが適切に運用されるためには、従業員全体がその内容を理解し、実践する必要があります。

社内周知を行う際には、研修やワークショップを活用することが効果的です。例えば、生成AIの利用における倫理的課題や法的リスクについて具体的な事例を交えながら説明することで、従業員の理解を深めることができます。また、ガイドラインの内容を簡潔にまとめた資料を配布することで、従業員が日常業務で参照しやすくすることも重要です。

3.定期的に見直し・更新する

生成AIガイドラインは、一度策定したら終わりではありません。技術の進化や社会的な状況の変化に応じて、定期的に見直し・更新することが不可欠です。

例えば、新しい生成AI技術が登場した場合や、法的な規制が変更された場合には、ガイドラインの内容を修正する必要があります。また、従業員からのフィードバックや実際の運用状況をもとに、ガイドラインの実効性を評価し、改善点を特定することが求められます。

さらに、定期的な見直し・更新を行うことで、ガイドラインが常に最新の状況に対応した内容となり、企業や組織が生成AIを安全かつ効果的に利用するための基盤を提供することが可能です。例えば、生成AIを利用した新しいサービスの開発において、倫理的課題や法的リスクに対応するための具体的な指針を追加することで、ガイドラインの実効性を向上させることができます。

プロンプト活用を“業務で安全に”進めるための

生成AIガイドライン策定のポイント

プロンプトを工夫すれば生成AIの出力品質は高まりますが、使い方次第では情報漏洩やコンプライアンス面のリスクも増えます。業務活用を広げるほど「社内ルール」の整備が欠かせません。

本資料では、生成AIガイドラインが必要な理由から、特有のリスク整理、作り方、盛り込むべき項目例までを解説。生成AIを安心して業務活用するための、ガイドライン策定・見直しの参考としてご活用ください。

まとめ

生成AIの活用が進む中で、適切なガイドラインの策定は不可欠です。国や行政機関、企業・法人が独自のガイドラインを策定することで、技術の安全性や倫理性を確保し、社会全体の利益を最大化することが可能となります。また、ガイドラインを策定する際には、ひな形の作成、社内周知、定期的な見直し・更新が重要なステップとなります。

これらの取り組みを通じて、生成AIが安全かつ効果的に利用される環境を整備することが求められます。生成AIガイドラインは、技術革新を促進する一方で、社会的責任を果たすための重要なツールであり、その策定と運用が今後ますます重要になってくるでしょう。