Transformerとは?仕組みや活用するメリットを分かりやすく解説

2026年03月31日

近年の生成AIや検索、翻訳の進化を語るうえで、中心にいるのがTransformerです。とはいえ「名前は聞くけれど、仕組みが難しそう」と感じる方も多いでしょう。

本記事では、Transformerの基本概念や成り立ち、種類の違いについて整理し、導入するメリットをビジネス観点で解説します。

AX実施率56.9%|AIトランスフォーメーション最新動向調査

AI活用を進める企業が増える中、AX(AIトランスフォーメーション)を実施している企業は56.9%と、すでに半数を超えています。その一方で、人材不足(54%)・スキル不足(47.4%)が大きな壁となっています。本資料では、AXの実施率や推進体制、活用施策、成果と課題、人材育成の実態を調査データで整理。AIに関する知識や理解が、企業の中でどのように活かされ、どこで課題が生まれているのかを知るための判断材料としてご活用ください。

Transformerとは

Transformerは、文章や音声などの時系列データを扱う深層学習のモデルで、注意機構と呼ばれる仕組みを軸に情報の関係を捉えるアーキテクチャです。従来は「前から順に読む」モデルが主流でしたが、Transformerでは入力全体を見渡し、重要な要素へ重点的に目を向けられます。これにより、長い文でも要点を見失いにくく、翻訳や要約、検索などで強みを発揮します。

Transformerの理解で外せないのが、自己注意と呼ばれる考え方です。自己注意は、文中の各単語が「他のどの単語と関係が深いか」を点数化し、重要なつながりを強調する仕組みです。たとえば「銀行で口座を作った」という文では、「銀行」と「口座」の結びつきが強くなりやすい、という具合です。これが積み重なることで、単語の意味だけでなく文脈上の役割も捉えられるようになります。

もう一つのポイントは、Transformerは学習や推論の設計次第で、文章理解にも文章生成にも対応できることです。人が読む側のタスクと書く側のタスクを、同じ土台で扱えるため、業務応用の幅が広いのです。言語の扱いを共通基盤に寄せられる点は、DXを進める会社にとって大きな魅力になってくるでしょう。

Transformerの成り立ち

ここではTransformerの背景を、必要な範囲に絞って押さえます。結論から言うと、Transformerは「順番に処理しないと難しい」という前提を崩し、注意機構を中心に据えたことで一気に広まりました。歴史を知ると、なぜTransformerが速く、強く、応用範囲が広いのかが理解しやすくなります。

Transformerは、機械翻訳などの系列変換の課題に対して提案されたアーキテクチャとして知られています。従来の主流であった再帰型や畳み込み型のアプローチでは、長い文で前半の情報が弱くなったり、処理が逐次的になって計算が重くなったりしがちでした。そこで、系列を扱う中心機構を注意に置き、再帰や畳み込みに頼らない設計が提示され、翻訳タスクで高い性能と学習効率を示したことが大きな転機になりました。

実務目線で言い換えると、Transformerは「読む順番に縛られない」ことで、学習と推論の設計自由度を上げたのです。もちろん、文の順序情報が消えてしまうと困るので、順序を表す工夫も組み込まれています。ここがうまく噛み合うことで、文脈のつながりと計算効率の両方を狙えるようになりました。

そして現在では、Transformerは自然言語だけでなく、画像や音声などにも広く応用されています。つまりTransformerは、特定タスクのための小技ではなく、複数領域で使える汎用アーキテクチャとして定着したと言えます。だからこそ、AIの基盤技術として理解しておく価値が高いのです。

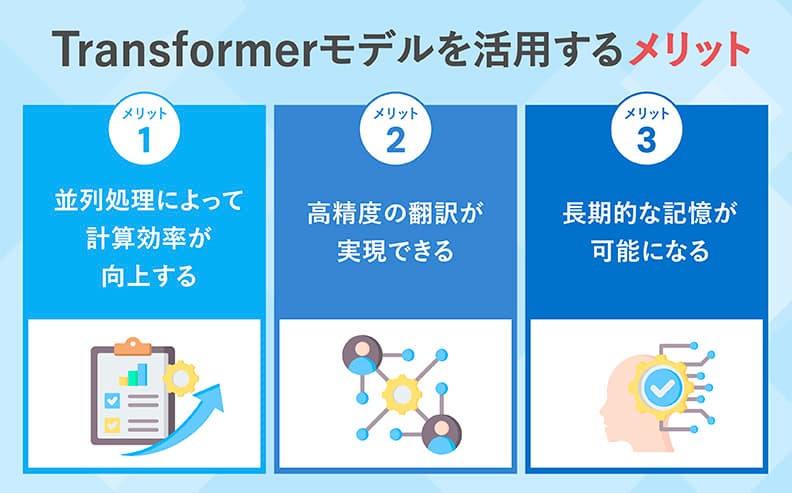

Transformerを活用するメリット

ここではTransformerを使うことで、なぜ価値が出やすいのかをメリットとして整理します。重要なのは「すごいから使う」ではなく、仕組みの特徴が業務課題にどう効くのかを言語化することです。そうすると、導入判断や投資説明が筋の通った形になっていきます。

並列処理によって計算効率が向上する

Transformerの大きな強みは、入力を一つずつ順に処理する設計に比べて、並列化しやすい点です。自己注意では入力全体を参照するため一見重く感じられますが、計算をまとめて進めやすく、ハードウェアの性能を引き出しやすいのです。

ビジネスでは、学習や推論の時間が短いほど、改善の試行回数を増やせます。試行回数が増えると、評価と改善が回りやすくなり、結果として品質が上がりやすい。つまり計算効率の向上は、単なるコスト削減ではなく、改善スピードを上げる土台にもなってくるでしょう。

高精度の翻訳が実現できる

Transformerは機械翻訳で存在感を強めた経緯があり、文脈を踏まえた訳文生成に強みがあります。単語単位で置き換えるのではなく、文全体の関係を見て訳語を選びやすいため、不自然な直訳が減りやすいのです。翻訳における注意点は、正確さだけでなく、文体や専門用語の統一にもあります。Transformerを使うと、用語集やルールを組み合わせた運用設計がしやすくなり、品質を安定させやすい傾向があります。

海外展開や多言語問い合わせがある会社では、翻訳の品質と速度がそのまま顧客体験に響きます。だからこそ、翻訳を「人による作業」だけに閉じず、Transformerで下支えする価値が出てくるのです。

長期的な記憶が可能になる

Transformerは、遠く離れた単語同士の関係も注意で直接つなげられます。順番に処理するモデルでは、前半の情報が後半へ届くまでに薄まりやすい場面がありました。一方Transformerでは、必要な情報へ一足飛びに参照を向けられるため、長い文章でも要点を見失いにくくなります。

もちろん「無限に覚えられる」という意味ではありません。扱える文脈の長さには上限があり、長文では設計の工夫も必要です。それでも、長距離依存を捉えやすい特性は、契約書や仕様書、議事録のような長文業務で効いてきます。長い文を読む仕事が多い会社ほどメリットが出やすいと考えると、納得しやすいでしょう。

Transformerを基にしたモデル

Transformerは他のモデルの土台として広く使われています。その代表的なモデルを覚えるポイントは「名前を覚える」よりも、どの方向に強い設計なのかを押さえることです。文章生成に強いのか、文章理解に強いのか、音声や画像に広げたのかで、導入先の業務も変わってきます。

GPT

GPTは、主に文章を生成する方向に強いTransformerです。入力された文脈から次に続く単語を予測し、自然な文章を積み上げていく設計が特徴です。スケールを大きくすると汎用的な性能が伸びやすいことが示され、GPT-3は大規模な自己回帰言語モデルとして少数例の提示でも幅広いタスクに対応できると報告されています。

ビジネスにおける使いどころとしては、社内文書のたたき台作成、問い合わせ返信文の下書き、議事録の要点整理、ナレッジ検索の回答文生成などが想像しやすいでしょう。一方で、生成がうまいほど「もっともらしい誤り」も混ざり得ます。ここは仕組み上の性質なので、運用でカバーする発想が重要です。具体的には、根拠となる社内資料を参照させる、回答に引用元を添える、重要業務は人が最終確認する、といった設計で業務の安全域を作ることが欠かせなくなってきます。

BERT

BERTは、文章を理解する方向に強いTransformerとして知られています。特徴は、前後の文脈を同時に見ながら表現を学習する双方向性で、質問応答や分類など多くの自然言語処理タスクに適用しやすいと説明されています。

ビジネスでは、文書分類、意図推定、検索クエリの理解、FAQの候補提示など、「読む」系の基盤として活用されやすいモデルです。生成系と比べると、出力が選択や分類に寄るため、要件定義と評価が組み立てやすい傾向があります。まずはBERT系で理解タスクを安定させ、次に生成を組み合わせて体験を上げる、という進め方も堅実になってくるでしょう。

PaLM

PaLMは、Googleが報告した大規模Transformer言語モデルで、Pathwaysという学習基盤を使い、スケールの拡大によって少数例学習を含む多様なベンチマークで性能が伸びるとされています。 大規模化の効果を整理しながら、言語理解だけでなく生成、推論、コードといった幅へ広げていく流れの中で位置づけられるモデルだと捉えると分かりやすいはずです。

また、後継のPaLM 2は、より計算効率や多言語性、推論能力を意識したTransformerベースのモデルとして技術報告が公開されています。 ここで押さえたいのは、モデルの世代が進むほど「性能」だけでなく「運用のしやすさ」も競争軸になっている点です。会社でAIを回す立場から見ると、精度に加えてレイテンシやコスト、監査性まで含めて評価しないと、継続運用が難しくなってきます。

Conformer

Conformerは、音声認識の文脈で提案されたTransformer系モデルで、自己注意で長距離の依存関係を捉えつつ、畳み込みで局所的なパターンも扱えるように組み合わせた設計です。

音声は、言語の意味だけでなく、短い時間幅の変化や発音のクセも効いてきます。Conformerはこの現実に寄り添った形で、Transformerの強みを音声に持ち込んだアプローチだと言えるでしょう。会社での活用としては、コールセンターの自動文字起こしの品質向上、会議の音声から議事録生成の土台作りなどが現実的です。音声が安定すると、その後段の自然言語処理が一気に進むため、結果として業務の自動化ライン全体が強くなっていきます。

Deformer

Deformerは、文脈によって指すものが複数あります。自然言語処理の文脈では「事前学習済みTransformerを分解して高速化する」方向の研究としてDeformerが報告されています。質問応答モデルの推論を軽くしつつ、再事前学習なしに対象タスクへ直接適用できる旨が述べられています。

このモデルが活躍するのは、精度だけでなく速度やメモリ制約が厳しい現場です。たとえば社内検索をリアルタイムに返したい、端末側で動かしたい、推論コストを抑えて利用範囲を広げたい、といった要件がある会社では、こうした発想が重要になってくるでしょう。Transformerは強力な半面、重くなりやすいので、軽量化は導入の必須条件になります。

T5

T5は、さまざまな自然言語処理タスクを「テキストを入力してテキストを出す」という同一形式に統一する枠組みとして提案されています。これにより、分類も要約も翻訳も、同じインターフェースで扱いやすくなります。

ビジネス観点で見ると、複数タスクを別々のモデルで作ると、運用が複雑になりやすいという悩みが出ます。T5的な統一思想は、評価指標やデータ管理の形式もそろえやすく、AI活用の内製化を進めるときに地味に効いてきます。モデル選定の段階でも、タスクの統一は開発コストの見通しを立てやすくしてくれるでしょう。

ViT

ViTは、画像を小さなパッチに分けて系列として扱い、Transformerで画像認識を行う設計として示されています。大規模事前学習と転移によって、画像分類で良好な結果を示すと報告されています。

ビジネスでの用途は、外観検査、店舗の棚画像からの状態把握、医用画像の補助など幅広い一方、画像データの収集とアノテーションが壁になりがちです。だからこそ、最初は「判定基準が明確な画像タスク」に絞ると成果が出やすいでしょう。ViTの考え方を理解しておくと、画像領域でもTransformerが当たり前に使われている理由が見えてきます。

Transformerに関連する用語

Transformerを理解するうえで、周辺用語を押さえておくと説明がスムーズになります。ここではRNNやCNNなどの用語を紹介します。

RNN

RNN(Recurrent Neural Network:再帰型ニューラルネットワーク)は、系列データを順番に処理して状態を引き継ぐモデルです。文章を前から読む発想に近く、音声や文章の取り扱いで長く使われてきました。ただし、長い系列になるほど過去の情報が薄れやすく、学習も逐次的になりがちです。ここがTransformerの並列性や長距離の関係性の捉えやすさと対比されるポイントになります。

RNNは今でも用途がありますが、長文処理や高速学習を狙う場面ではTransformerが選ばれやすいでしょう。ビジネスにおける意思決定としては、データ量、必要な文脈の長さ、推論速度の要件を照らし、どこに投資すべきかを見極めるのが現実的です。

CNN

CNN(Convolutional Neural Network:畳み込みニューラルネットワーク)は、局所的なパターンを捉えるのが得意なモデルです。画像認識の代表格として知られ、音声やテキストにも応用されてきました。局所性に強い一方で、離れた要素同士の関係を捉えるには工夫が必要になります。

Transformerは、注意機構で全体の関係を直接扱いやすいのが強みです。ただし、局所パターンが重要な領域ではCNNの発想が今も効きます。その折衷としてConformerのように、畳み込みとTransformerを組み合わせる設計が提案されているのは象徴的でしょう。

深層学習(ディープラーニング)

深層学習は、多層のニューラルネットワークで特徴表現を学習する枠組みで、Transformerもその一部です。深層学習の価値は、人が特徴量を手作業で設計しなくても、データから有用な表現を学べる点にあります。

ビジネスで深層学習を扱うときは、モデルの高度さよりも、データの品質、評価設計、改善サイクルが成果を左右します。Transformerは強力ですが、良い入力と良い評価がなければ力を発揮しません。つまり、技術導入の成否は、モデル選定より先にデータ設計で決まることも少なくないのです。

【関連記事】ディープラーニングとは? 意味や定義をわかりやすく解説

自然言語処理(NLP)

自然言語処理は、人の言葉をコンピュータで扱う技術領域です。Transformerが普及したことで、翻訳、要約、検索、対話など多くの自然言語処理タスクが一段押し上げられました。BERTが文章理解を、GPTが文章生成を、それぞれ強くした流れは自然言語処理の実務にも直結しています。

ビジネスで自然言語処理を使うときは、用途を「読む」または「書く」で整理するとブレにくくなります。読むなら分類や抽出で品質を固め、書くなら根拠参照とレビューで安全性を担保する。この組み立てができると、Transformerの価値を現場に落とし込みやすくなってくるでしょう。

AX実施率56.9%|AIトランスフォーメーション最新動向調査

AI活用を進める企業が増える中、AX(AIトランスフォーメーション)を実施している企業は56.9%と、すでに半数を超えています。その一方で、人材不足(54%)・スキル不足(47.4%)が大きな壁となっています。本資料では、AXの実施率や推進体制、活用施策、成果と課題、人材育成の実態を調査データで整理。AIに関する知識や理解が、企業の中でどのように活かされ、どこで課題が生まれているのかを知るための判断材料としてご活用ください。

まとめ

Transformerは、注意機構を中心に据えることで、文脈理解と生成の両方に強みを持つ深層学習アーキテクチャです。並列化しやすく、長い文脈も扱いやすい特性から、翻訳や要約、検索、対話、音声認識、画像認識へと応用が広がりました。最終的に成果を分けるのは、モデル名の選択よりも、データと評価と運用です。根拠を確認できる仕組み、改善を回す仕組みを用意できれば、Transformerは会社の知的生産を底上げする頼もしい基盤になっていきます。