ディープフェイクとは?活用例や悪用された場合の対策について解説

2026年03月31日

ディープフェイクという言葉を、ニュースやSNSで見かける機会が増えました。AIでリアルな映像や音声を作れる一方で、悪用されると詐欺や情報操作にもつながりかねません。

本記事では、ディープフェイクの基本から仕組み、ビジネスでの活用例、そして悪用リスクと対策までを解説します。

【お役立ち資料】AI時代に求められる企業のセキュリティ対策実践BOOK

ディープフェイクは、映像や音声を高度に再現できる一方で、悪用されると詐欺や情報操作、なりすましといった深刻なリスクにつながります。こうした問題はディープフェイクに限らず、生成AI全般に共通するリスクであり、技術対策だけで防げるものではありません。

本資料では、生成AI活用に潜むセキュリティリスクを整理したうえで、企業として取り組むべきセキュリティ対策とポイントを解説しています。生成AIを安心して活用するための基盤づくりにお役立てください。

ディープフェイクとは

ディープフェイクは、AIを使って本物らしい画像や動画、音声を合成する技術や、その合成コンテンツを指します。ポイントは、単なる加工ではなく、学習済みモデルが人の顔や声の特徴を捉え、別の素材に自然に重ね込める点にあります。上手く作られたディープフェイクは、ぱっと見や一度聞いただけでは違和感が少なく、見る側の判断を揺らしやすいところが怖さでもあり、同時に活用余地でもあります。

企業の文脈で捉えるなら、ディープフェイクは「表現の幅を広げる手段」である一方、「信用を前提にした業務を壊し得る手段」でもあります。便利さと危うさが同居しているため、技術の理解と運用ルールがセットになって初めて、味方となるでしょう。

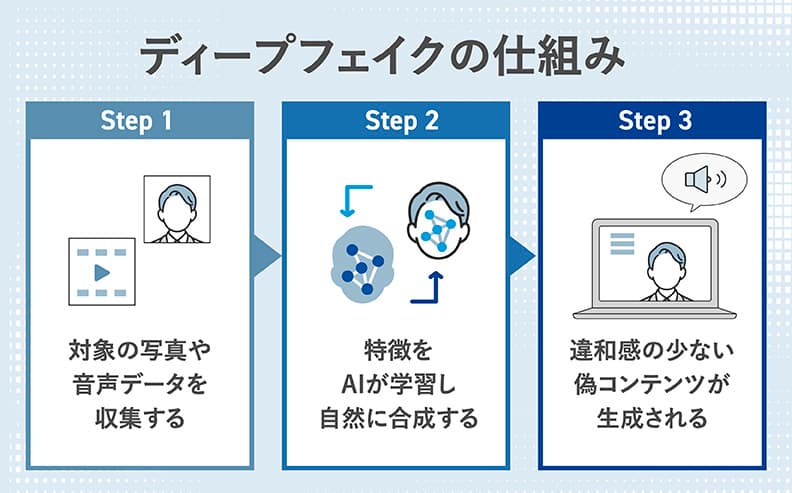

ディープフェイクの仕組み

ディープフェイクは、「大量の例から特徴を学び、別の素材にその特徴を反映して出力する」仕組みです。代表的な方法としては、顔の入れ替え、口元の動きの同期、声のクローンなどがあります。

顔の入れ替えでは、対象人物の顔の形、目や口の位置関係、肌の質感、表情の癖といった情報をモデルが学習します。そのうえで、別の動画に合わせて表情や向きを追従させ、フレームごとに自然な顔を合成します。映像が本物らしく見えるかどうかは、顔だけでなく、首元の影、髪の毛の境目、瞬きのタイミング、音声と口の動きの一致など、細部の整合性に左右されます。近年はこの「整合性」を高める技術が進み、違和感が出にくくなっています。

音声のディープフェイクは、声の高さだけでなく、話す速度、間の取り方、アクセント、息遣いなどを含めた「その人らしさ」を学習します。すると、短いサンプルでも、本人に似た声で任意の文章を読み上げられる場合があります。ここが厄介で、たとえば社内の承認や取引先との連絡のように「声で本人確認をしていた業務」は、前提が崩れやすくなります。

なお、検出技術も発展していますが、検出は常に後追いになりがちです。第三者機関も検出システムの評価やデータ整備を進めていますが、環境やデータが変わると性能が落ちることもあり、万能とは言い切れません。

ディープフェイクの活用例

ディープフェイクは設計と運用を誤らなければ、表現やコミュニケーションを前進させる武器になります。ここでは、企業が現実的に検討しやすい活用の方向性を二つに分けて紹介します。

CGを使った動画・映像

映像制作の現場では、これまでもCGで顔や背景を作り込むことがありました。ディープフェイク的な技術が入ってくると、置き換えが効く範囲が広がり、制作の選択肢が増えます。

たとえば、製品紹介動画を複数言語に展開するケースを考えてみましょう。従来は、言語ごとに撮り直したり、吹き替えに合わせて編集したりする必要があり、時間とコストが膨らみがちでした。ここで、口元の動きを音声に合わせて自然に調整できれば、撮影素材を活かしながら、視聴体験を損ねにくい形でローカライズできます。これは単なるコスト削減ではなく、発信のスピードを上げ、機会損失を減らすことにつながります。

また、研修動画の更新にも向いています。制度変更や手順変更が起きるたびに撮り直すのではなく、必要な部分だけ差し替えられれば、最新情報を届けやすくなります。現場にとっては「古い動画を見てしまう」リスクが下がり、管理側にとっては教育の品質を保ちやすくなるでしょう。

ただし、ここで重要なのは同意と表示です。実在の人物の顔や声を素材にする場合、本人の許諾なく作るのはトラブルの火種になります。さらに、視聴者が「これは加工された映像かもしれない」と理解できる配慮があるほど、信頼を積み上げやすくなります。EUでは、ディープフェイクなど合成コンテンツに関する透明性義務の議論と実装が進んでおり、表示やラベリングの考え方は企業実務にも影響し得ます。

対話型AI

対話型AIとディープフェイクは別物に見えますが、実務では交差します。たとえば「人のように話し、人のように表情を動かす窓口」を作るとき、音声合成と映像合成が組み合わさり、ディープフェイクに近い技術要素が入ってくるからです。

企業の活用シーンとしては、カスタマーサポートや社内ヘルプデスク、店舗の案内などが想像しやすいでしょう。テキストだけのチャットよりも、表情や声があると安心感が増す場面があります。たとえば、初めて使うサービスの手続き案内は、文字情報だけだと不安になりがちです。ここで、落ち着いた声と分かりやすい表情でナビゲートできれば、利用者の心理的ハードルを下げられます。結果として、問い合わせの集中を緩和し、担当者が対応すべき難易度の高い相談に時間を回しやすくなります。

また、採用や広報でも「双方向の説明」が求められる場面があります。説明会の動画をただ流すのではなく、候補者の質問に合わせて回答が変わる仕組みは、体験として魅力が出ます。ただしこの領域は、本人らしさを強く出すほど、誤解も生まれやすいのが難点です。「実在の社員に見えるキャラクター」を作るなら、肖像や声の扱いを契約とガイドラインで固め、利用者にも分かる形で明示することが欠かせません。

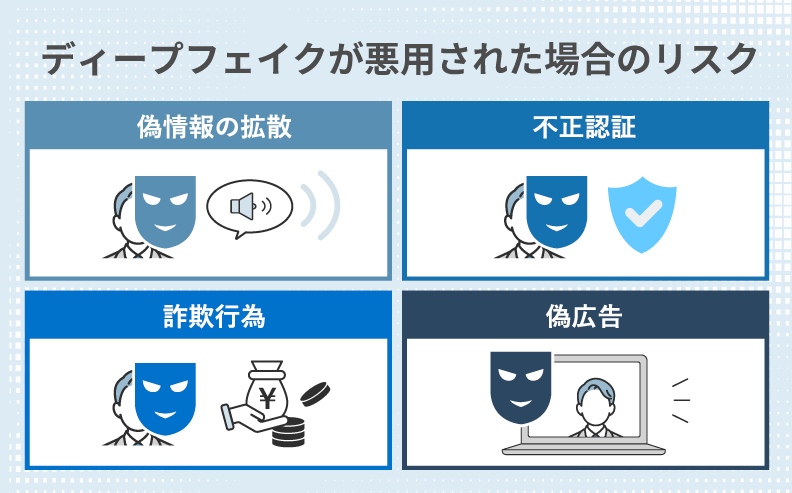

ディープフェイクが悪用された場合のリスク

ディープフェイクのリスクは、単に「人をだます」だけではありません。企業にとっては、金銭被害、情報漏えい、レピュテーション低下、意思決定の混乱など、複数の損失が連鎖しやすい点が本質です。ここでは代表的なリスクを解説します。

なりすまし詐欺

なりすまし詐欺は、最も分かりやすく、そして現実に起きやすいリスクです。狙われるのは「緊急性が高く、確認が省略されやすい業務」です。たとえば、経理担当に対して「今すぐこの口座に送金してほしい」という連絡が来る場面を想像してください。テキストでも危険ですが、ここに上司の声に似た音声が加わると、心理的な圧力が増します。

この手口が厄介なのは、技術だけでなく人の行動特性を突いてくる点です。人は、権威ある相手からの指示や、時間制約のある依頼に弱い傾向があります。つまり、ディープフェイク対策は技術導入だけで終わらず、承認フローと確認行動を設計し直す話になってきます。 さらに近年は、個人だけでなく、著名人や企業幹部のディープフェイクが拡散し、信用を毀損するケースも懸念されています。合意のない性的ディープフェイクを犯罪化する動きなど、被害の深刻さに対応する法整備も進んでいます。

サイバー攻撃

サイバー攻撃の文脈でのディープフェイクは、主にソーシャルエンジニアリングの強化として現れます。メールやチャットでのフィッシングに加え、音声や映像が使われると、攻撃の成功率が上がりやすいのです。

たとえば、IT部門を名乗る人物が、社内のメンバーに「アカウントがロックされるので確認コードを教えてほしい」と電話してきたとします。声が上司や同僚に似ていれば、受け手は警戒を解きやすくなります。あるいは、取引先担当者になりすまして「請求書の送付先を変更してほしい」と連絡し、支払いの流れを乗っ取る手口も考えられます。

ここで怖いのは、ディープフェイクが単独で完結しない点です。漏えいした個人情報、SNSで拾える行動履歴、組織図の情報などと組み合わさると、話の筋が通ってしまい、受け手が「本物だ」と判断しやすくなります。だからこそ、多要素認証やコールバック確認のような仕組みが、今まで以上に重要になってくるでしょう。

情報操作

情報操作は、企業にとって長期的な損失を生みやすいリスクです。ディープフェイクは、事実に見える映像や音声を使って、世論や評価を動かそうとします。

たとえば、企業の不祥事を示唆する偽の動画が拡散すれば、真偽が判明する前に株価や採用、取引に影響が出る可能性があります。社内向けでも同様で、経営陣が何かを発言したように見える動画が出回れば、従業員の不安をあおり、組織の意思決定を乱しかねません。ディープフェイクは、情報の中身だけでなく「証拠っぽさ」を持ち込めるため、反論コストが上がります。否定の声明を出しても、「本当にそうか」と疑われ続ける状態が残りやすいのです。

さらにディープフェイクが増えるほど、今度は本物の映像や証言まで「ディープフェイクかもしれない」と疑われやすくなります。こうなると、社会全体の信頼が薄れ、企業も説明責任を果たしにくくなります。実際、来歴情報の仕組みを埋め込んでも、プラットフォーム側が表示や保持を徹底しないと効果が出にくいという指摘もあります。

ディープフェイクへの対策と取り組み

ディープフェイク対策は、万能の一手がある分野ではありません。だからこそ、情報リテラシー、業務プロセス、技術の三つを組み合わせ、被害が起きにくい環境を作る発想が現実的です。ここでは、日々の行動に落とし込みやすい順に整理します。

情報の出所を確認する

最初の基本は、情報の出所をたどることです。ディープフェイクは「切り抜き」で拡散するほど強くなる傾向があります。短い動画や一部の音声だけが出回ってきたときこそ、冷静に出所を確認したいところです。

企業としては、従業員に「怪しい情報は確認すべき」と丸投げするより、確認の型を用意したほうが機能します。たとえば、社内で使うなら「緊急の送金依頼は、指定のチャンネル以外では受けない」「役員を名乗る依頼でも、別経路で折り返す」といったルールです。これは不便に見えますが、一度ルール化すると迷いが消え、現場の判断負荷が下がるという利点があります。

外部情報についても同じで、一次情報に当たりにいく習慣が有効です。公式サイト、公式発表など、確認先が明確な情報ほど、偽情報に振り回されにくくなります。

複数の情報源と照らし合わせて比較する

出所確認とセットで効果的なのが、複数の情報源を比べることです。ディープフェイクは「一つの強い証拠」を作れてしまうのが特徴ですが、現実の出来事は、通常は複数の地点で痕跡が残ります。公的機関の発表、複数メディアの報道、関係者の説明など、独立した情報が一致するかを見るだけでも、だまされる確率は下げられます。

社内でも、同じ考え方が使えます。たとえば、取引条件の変更依頼が来たときに、メールだけでなく契約書管理システムの履歴や、過去の連絡先台帳、担当部署の確認など、複数の根拠を照合する運用にします。ここで重要なのは、照合を「担当者の善意」に任せないことです。チェックポイントを業務フローに埋め込むと、疲れている日でも一定の防御力が維持できます。

発信する情報に注意する

対策というと受け身になりがちですが、企業は発信側でもあります。発信する情報が、ディープフェイクの材料として使われる可能性を意識することも、現実的な取り組みです。

たとえば、幹部の高音質なインタビュー動画、社内イベントの長尺映像、社員の音声がはっきり入った配信などは、本人らしさを学習する材料になり得ます。もちろん、広報として必要な発信まで止める必要はありません。ただ、公開範囲、素材の扱い、削除依頼の窓口、なりすまし発生時の対応手順などを整えておくと、いざというときの被害拡大を抑えやすくなります。

加えて、なりすましに使われやすい情報を減らす工夫も効きます。役職者の連絡手段をむやみに公開しない、緊急連絡の正式ルートを周知する、請求書や口座変更の手続きに本人確認ステップを挟むなどです。これは地味ですが、ディープフェイクが絡む詐欺ほど、最後は「ルールの穴」を突いてきます。

【お役立ち資料】AI時代に求められる企業のセキュリティ対策実践BOOK

ディープフェイクは、映像や音声を高度に再現できる一方で、悪用されると詐欺や情報操作、なりすましといった深刻なリスクにつながります。こうした問題はディープフェイクに限らず、生成AI全般に共通するリスクであり、技術対策だけで防げるものではありません。

本資料では、生成AI活用に潜むセキュリティリスクを整理したうえで、企業として取り組むべきセキュリティ対策とポイントを解説しています。生成AIを安心して活用するための基盤づくりにお役立てください。

まとめ

ディープフェイクは、映像や音声を高精度に合成できる技術であり、表現の幅を広げる可能性がある一方で、なりすまし詐欺・サイバー攻撃・情報操作などで悪用され、企業の信用や業務を揺るがすリスクも抱えています。だからこそ、活用を検討する場合は「許諾と表示」を徹底し、悪用に備える場合は「出所確認」「複数情報源の照合」「発信情報の管理」を運用ルールとして固めることが欠かせません。意思決定や送金など重要業務のフロー自体を万全にすることが、ディープフェイク時代に不可欠な対策になってくるでしょう。